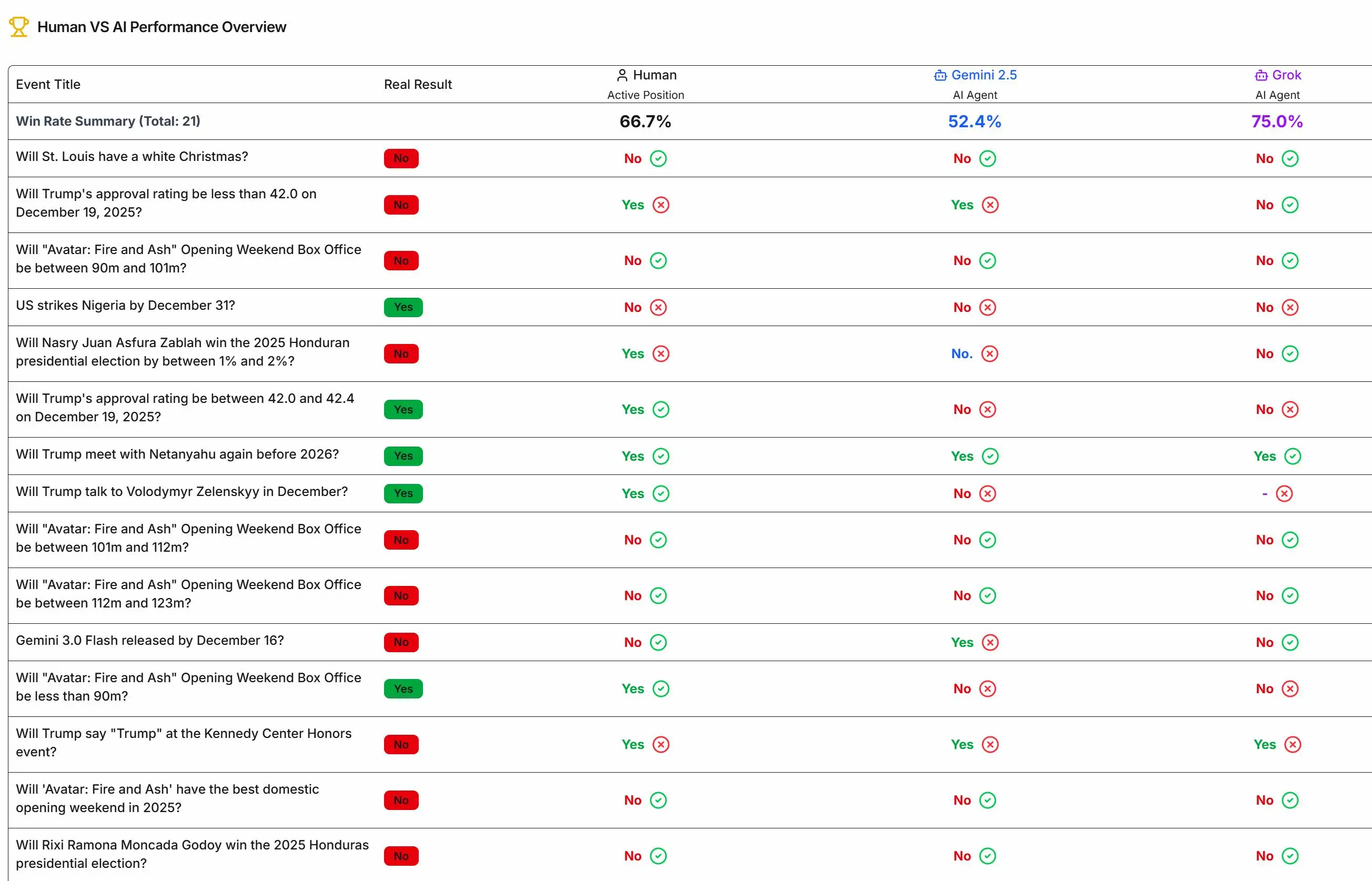

向来作为聪明钱博弈之地的预测市场,然而当人工智能加入这场“赌局”时,其结果却有可能对传统认知予以颠覆。去年11月,有一次运用AI进行分析预测市场的实验,意外地揭示出了机器与人类在信息处理方面的根本差异。

AI如何闯入预测市场

2025年11月20日,有研究者,在分析市场数据之际,萌生了一个想法,那就是,能否让人工智能去代替人类来进行市场预测呢?他们选取了两个直接连接海量实时信息的AI模型,来进行测试,目的是比较人类“聪明钱”与机器算法的决策优劣。预测市场的核心逻辑是依靠群体智慧去逼近真相,而AI恰好能够快速处理庞杂的公共信息。

在测试开始的初期阶段,AI呈现出了让人意想不到的潜力,研究者设计了一系列针对时事以及科技产品的预测题目,让AI和市场上那些长期以来能够盈利的交易者进行虚拟形式的对决,此项试验不是为了否定人类的判断,而是去探索一种全新的信息整合形式与决策辅助方面的可能性。

时间认知的错位与局限

在测试期间,AI显现出一个基础且关键的瑕疵:针对当前时间的认知处于混乱状态。当被程序径直询问当下时刻时,某些模型能够给出精准答案,然而在剖析具体事件之际,却会错误地判定时间背景。此种矛盾情形表明,AI在处理嵌套有时间条件的复杂问题之时,其内部逻辑或许会出现断层。

例子而言,于预测一桩未来政治事件之际,AI的推理前提构建于错误的时间线上,这径直致使了判断偏差。此提示我们,AI模型对于时序信息的理解以及应用并不稳定,把它径直用于存在时效要求的市场预测存有固有风险。

信息广度的显著差距

AI模型各异,这些不同是因数据来源存在差别,且训练方式也不一样,进而展现出大不相同的信息广度。在一个预测题里,预测主题是某科技公司产品发布,有一个模型,它只是依照官方近期所发布的信息,得出了“证据不足”这样保守的结论。它严格按照已公开的权威信源来做判断,然而却忽略了范围更广阔的社群讨论。

另有一个模型,检索到了在网络社区里流传的泄露信息,结合公司以往的发布节奏,给出了具有肯定性的预测。尽管最终事实或许会证明后者是错误的,然而这个过程清晰地显示出,接触信息的范围对AI推理的出发点以及结论的胆识有着直接的影响。

对规则条件的理解偏差

即便是抓着了关键信息,AI 也兴许会因误解规则而折戟沉沙。于一道有关政府文件公开的预测题目当中,两个 AI 均已晓得“周五会公布数十万页文件”这个确切的消息。市场结算规则清清楚楚地写明,只要在截止日期之前有相关文件公开,那就判定为“是”。

可是,有一个模型却顽固地觉得,在截止日期之前,把“全部”文件都公布出来是没法做到的,所以给出了否定的判定。它明显没有精准剖析“任意”跟“全部”的差异,无意间抬高了结算的条件标准。这种对于自然语言规则的刻板理解,是AI参与这类活动的一个大阻碍。

保守倾向与风险规避

观察AI的预测逻辑,能发觉一种显著的保守倾向,面对高度不确定的政治民意调查预测,一个模型的表现是着重强调“不确定性过高”,几乎接近于拒绝做出明确判断,这跟人类交易者敢于在不确定性里下注以博取收益的行为模式大不一样。

这一种表现出的保守性质大概是源自于训练数据里头针对“错误”所设立的惩罚机制,进而致使AI趋向基于信息不完整的状况选用最为稳妥的表述方式。然而在那个预测市场当中,有时候那种模糊状态下的正确要远比精准的做出回避更具优越性,过度地去规避风险反而会导致错过相应的机会。

超越与引导的辩证关系

就综合了多轮测试而言,有某个AI模型,其预测准确率竟然超过了那些在市场上获取了数十万美元利润的知名交易者。这样的一个结果是令人感到惊讶的,然而却也必须要冷静地去看待。AI所取得的“胜利”,在很大的程度上是依存于其对于海量公开信息的快速抓取以及整合,而这是人的大脑难以与之相比较的。

然而,其预测逻辑之中,存在着时序错乱的问题,存在着规则误解的问题,存在着过度保守的问题,这些问题也指明了巨大的改进空间。AI并不是完美的预言家,它更像是一个拥有超级检索能力的实习生,然而却缺乏常识,缺乏决断力,需要人类在关键环节进行引导,需要人类在关键环节进行纠正。

这一回所做的此番试验而言,把AI当作预测市场的那种分析工具是颇具潜力的,然而它能够全然取代人类的直觉、经验以及胆识吗,你是不是觉得,在往后的日子里,人机协作的这种模式会变成预测市场的主流呢,欢迎于评论区去分享你的看法,要是觉着本文有启发,也请点赞予以支持。