AI具备自行开销调用各类服务的能力之际,它要怎样去判定所获取的结果毫无被篡改的现象呢?此一问题已然从理论层面的探讨转变成为了实际存在的风险。

传统预言机的局限

服务于公开且易于验证的数据的可谓是传统预言机,比如说在想要获取SUI代币的美元价格之际,去中心化预言机网络会促使多个独立节点去查询不同交易所,并且采用中位数当作最终结果,这样的机制依靠节点间的冗余验证,适用于数据来源清晰、有着变化规律的市场信息。

但在AI代理要调用私有API的场景里,传统方式遭遇挑战,。这些数据或许源自企业内部系统,,或许来自受版权保护的资料,,又或许来自需身份验证的服务,。这时让多个节点重复调用,,不但效率低,,还可能违反服务条款,。

中心化信任的风险

倘若AI代理依靠单一预言机节点去获取关键数据,那么便形成了中心化信任点。2023年诸多DeFi项目由于预言机数据遭操纵而致使损失超越1亿美元。在AI自主决策的情景里,错误数据或许会引发更为严重的连锁反应。

本质使然智能合约要求不信赖任何单一实体,使AI代理信任中心化数据源有违区块链核心原则,此问题于涉及金融交易、医疗诊断或法律咨询的高价值场景中格外凸显。

直接调用API的陷阱

从表面上来进行观察,让AI代理直接去调用API似乎它能够解决相应的问题,然而在实际的情况当中,AI没有办法去验证API响应是不是在传输的过程里被中间人进行篡改了,或者是API服务商本身是不是提供了正确的数据。

在2024年年初的时候,有一个知名的AI交易代理,它因为接收了被篡改过的市场数据,所以执行了错误的交易。哪怕使用的是HTTPS协议,也仅仅能够保证传输方面的安全,却没办法验证数据的真实性。这样的一种情况,在涉及数万美元的决策当中,是完全不可以被接受的。

零知识证明的解决方案

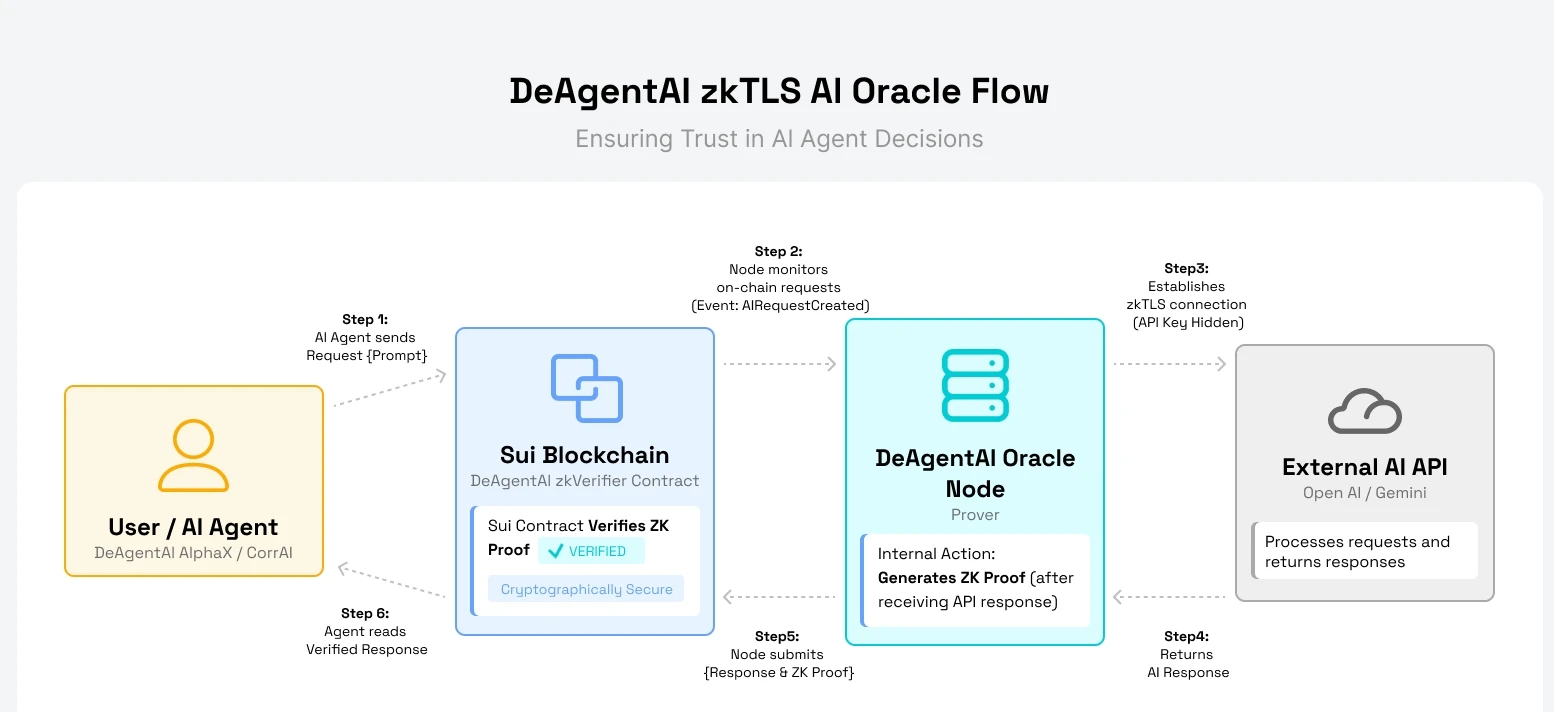

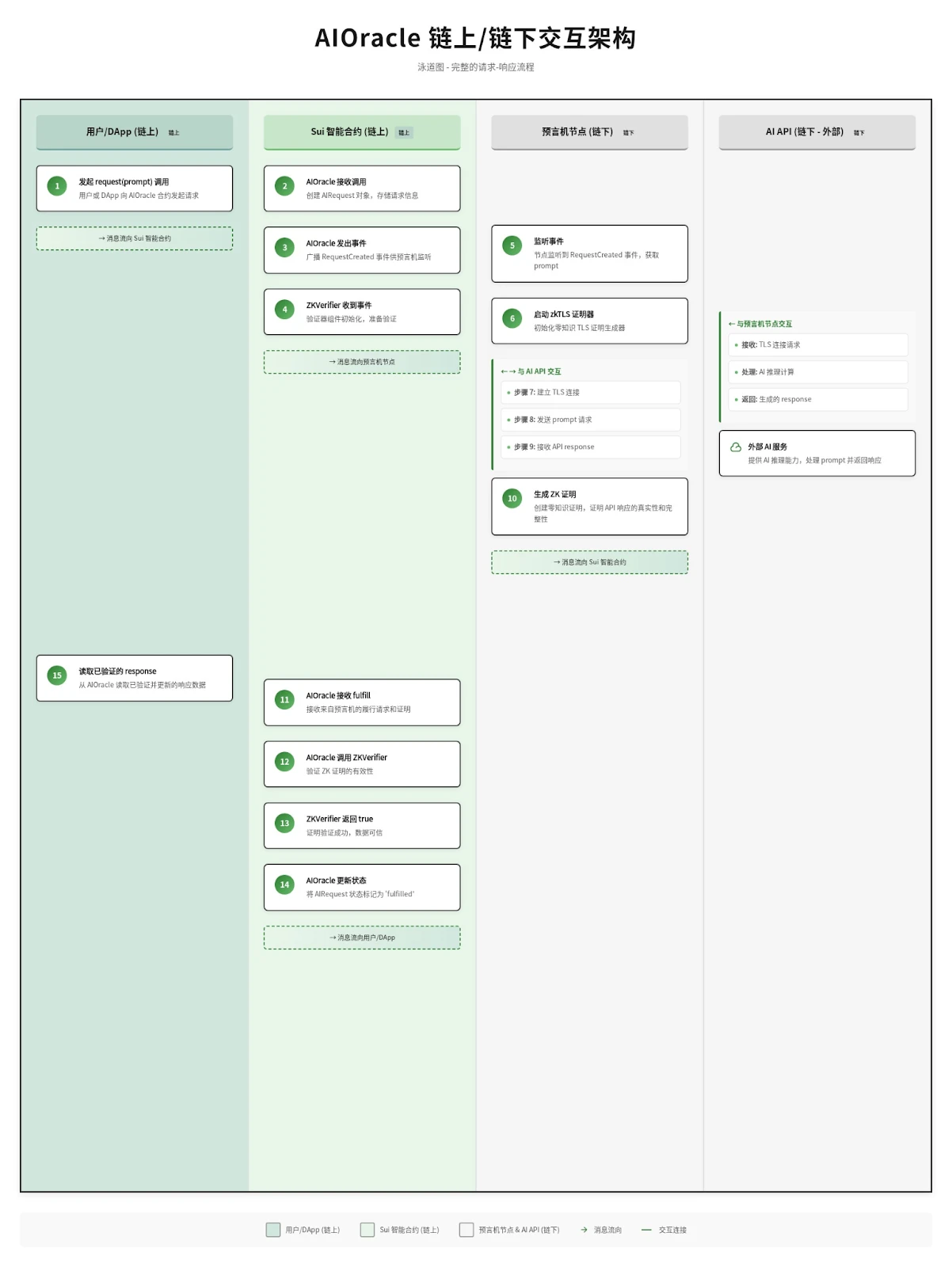

在不泄露隐私的具体情形下,借助零知识证明技术,基于zkTLS的预言机验证了数据真实性,从而提供了技术解决方案,该套系统能够证明某个API调用确实已然发生,并且返回结果未曾被篡改,与此同时还不会暴露API密钥等敏感信息。

该方案核心在于生成一个密码学证明,此证明要表明从发送请求开始,一直到接收响应的整个过程,全部都符合预期,智能合约仅仅只需验证这个证明在数学方面的正确性,并不需要去信任数据来源,也不需要信任预言机节点。

模块化设计优势

zkTLS预言机于架构方面采取清晰的模块化形式,将业务逻辑同密码学验证予以分离,此等设计使得未来能够对底层证明系统实施升级,且不必使整个预言机服务处于停止状态,维持了系统具备的可持续演进能力 。

依据2024年第二季度测试网数据呈现,该架构成功处置了超越10万次私有API调用,这些调用涵盖金融、医疗以及供应链等诸多领域,其证明生成时间平均为2.3秒,能够满足多数应用场景的需求。

应用场景与未来发展

这套系统,对需要调用私有数据的高价值场景而言尤其适配。量化基金能够借助它去验证专有交易信号,企业能够安全地把内部数据进行上链操作,医疗AI能够验证诊断结果来源,且无需泄露患者隐私。

在2025年的时候,ZK硬件加速技术走向成熟,此时证明生成成本有希望降低超过80%,这会让更多的AI代理可以负担得起可信数据验证服务,进而推动去中心化AI应用切实落地。

在AI自主决策越来越广泛普及的往后日子里,社会究竟应更加依赖密码学证明呢,还是传统信任机制呢,你是怎么认为的呢,欢迎把你的观点分享出来,要是觉得这篇文章有起到帮助作用的话,请点赞给予支持!